清华大学梅汝璈法学讲席教授冯象:欢迎来到硬规则世界

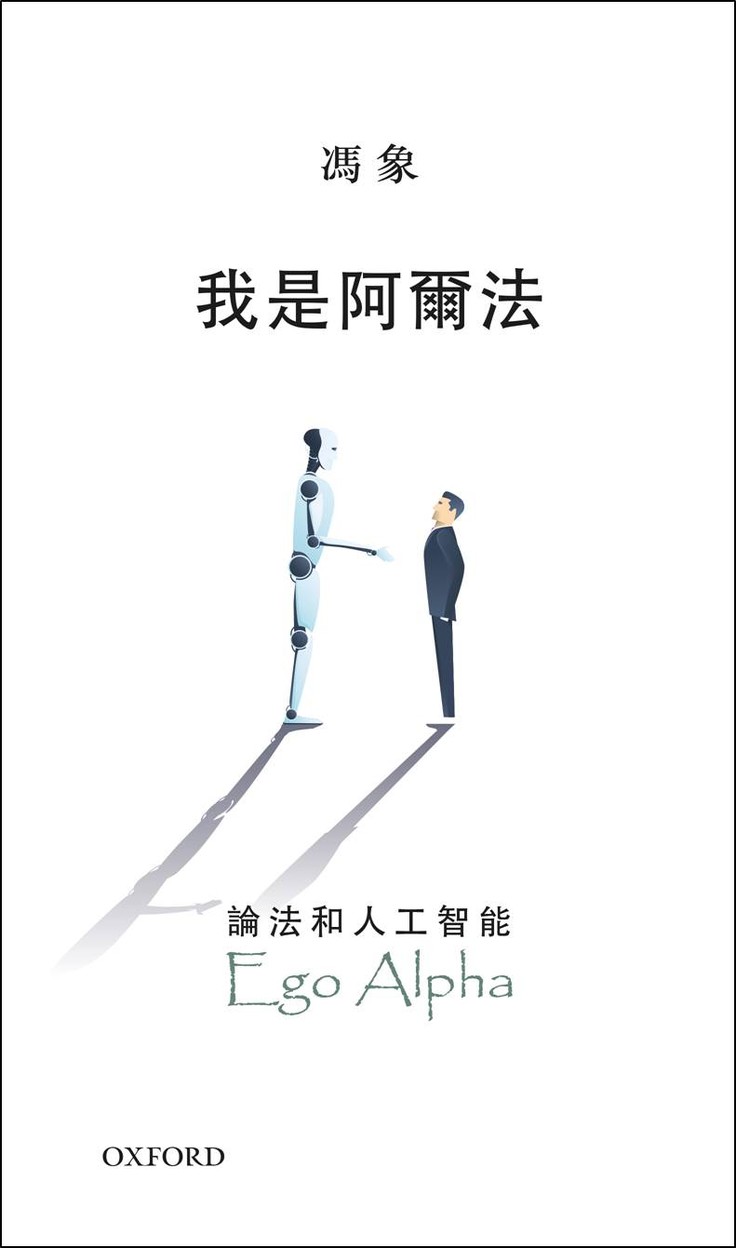

这是一本新书,《我是阿尔法》,封面画着两个人:机器人高出一头,向人类伸出手来,可是那个抬头仰视的人身子僵直,不愿握手。

“原本草稿上,俩人是一样大的。后来我建议机器人大点,人小点。”作者冯象先生说。

他说,国内学界讨论人工智能(AI),经常落入一个误区:把AI理解成了自动化问题。可是自动化,从发明轮船火车开始,产业升级“腾笼换鸟”的挑战,是人类社会一直在应对的,至少有200年了。人工智能之所以值得探讨,是因为地平线上升起了两片阴霾:大失业同AI军事化。终极的威胁则是,发展下去,人类可能会面临一个远比自己聪明的物种,其行为、性格与思想意识人绝对无法理解。这,才是新问题。

已故的麻省理工教授明斯基(1927-2016),人称AI教父,曾说:“智能的力量源于我们自身广博的多样性,而非某种独一无二的完美原则所赐”(The Society of Mind, 1986, p.308)。在他看来,本质上,人的感情和心理意识跟演算、逻辑推理没什么不同,都是智能的表现形式。人们引以为傲的各种智能,都可以还原为神经元相互作用的过程。

今天,有了大数据的条件,机器学习和神经网络研究突飞猛进。机器可以撇开“人类标注样本”或人的学习模式,自己寻找规律;或者基于海量的数据集,自我学习,实现升级。围棋机器人 AlphaGo Zero 经过三天自学,左右手互搏,下出来的棋,聂卫平估计,棋力高达三十段。这是人类的顶级(九段)选手如果不借助机器,穷其一生也难以领会的棋艺。

今天,有了大数据的条件,机器学习和神经网络研究突飞猛进。机器可以撇开“人类标注样本”或人的学习模式,自己寻找规律;或者基于海量的数据集,自我学习,实现升级。围棋机器人 AlphaGo Zero 经过三天自学,左右手互搏,下出来的棋,聂卫平估计,棋力高达三十段。这是人类的顶级(九段)选手如果不借助机器,穷其一生也难以领会的棋艺。

“如此精密复杂的机器智能,若是拿我们现在的法律规范跟教义学说,例如私法上的主体客体、侵权责任的认定标准,用这些教科书概念来讨论人机关系,分析各样后果,肯定是徒劳的。同样,人机伦理不能停留在抽象观念的推演建构,而应立足于人类社会在二十一世纪晚期资本主义阶段,所面临的深刻危机”。“想象人机关系,即想象人类的未来”。近日,冯象先生接受《文汇学人》采访,谈论了人机未来。

文汇报:冯先生,我们先聊聊一则新闻,苏富比拍卖涂鸦艺术家 Banksy 一幅名作。小锤落下,买卖成交,那幅画却逸出画框,自行切割成了布条。画家说,他在画框里藏了个机关,意在抗议资本市场拍卖艺术品。没想到,拍卖品这么“毁掉”,身价反而更贵了。

这令人想起人类学家喜欢讲的一个故事:部落祭礼半当中,突然跳进来一头老虎,搅乱了仪式。过后,村民说起此事,老虎却被当成仪式的一部分。换言之,部落祭礼具有很强的阐释性,连危机也能包容。是否资本主义体系也有这个能力,可以消解形形色色的反抗呢?

冯象:对,谁也不知道这家伙是谁。他小心翼翼从不露面,而且搞了这么个机关,巧妙地“骗过”了拍卖行,做得非常漂亮。不过问题也在这儿——看上去像是造反,实则并没有逃脱被市场机制收编、为文化冷战利用的命运。

此类反抗,从毕加索开始,套路都差不多。当然毕加索厉害多了,“造反”的范围广,劲道大,还参加了共产党。徐冰先生说,当代艺术是“一块像癌细胞一样的东西”,寄生在“整个世界经济、政治、文化的大的利益结构之内”。这话说到点子上了。寄生体不可能改变宿主的利益结构,反抗只是一种姿态。“那姿态其实是宿主体制运作的需要:那大体制需要一些癌细胞似的话语,包括行为艺术大腕儿什么的,来营造异见、贬低道德,或改写历史、转嫁责任”(《我是阿尔法》,页72)。

文汇报:但您认为,真正有可能颠覆资本主义体系的,是人工智能。为什么?

冯象:人工智能的近期风险,首先是“机器换人”,波及的行业有增无减,故称“大失业”;再有就是AI军事化。但在全球资本主义体系下,这趋势是无法控制的。竞争太厉害了,谁也不敢落后;谁不机器换人,不军事化,谁完蛋。这两样,人类过去没经历过,一个非常痛苦,一个非常危险。

危险,还因为AI技术不仅是“大国重器”,同时也跟日常生活搅在一块儿。智能终端(如手机)渗透了我们的学习和工作、家庭内外,而且一刻不停,永远在记录,在挖掘,在上传。如今我们常态的人与人之间的关系,是人通过机器跟另一个人接触:打招呼、聊天、点赞、炫酷或者骂人吵架。人与人直接交流的范围在萎缩,而人机捆绑(包括人-机-人模式)的范围在扩大。直至我们每个人像一片电脑插件,插入一张无所不包的天网,由它发布的最新应用程序(app)来组织安排每日的生活。

文汇报:这样一个通过机器和他人发生关系的智能社会,从法学角度看,有什么特点呢?

冯象:传统上,西方式法治社会是这样的,颁布法典,做到“有法可依”还不够;必须通过大众文艺和媒体反复灌输一套“真理”,诸如宪法至上、司法独立、“把权力关进制度笼子”之类,让老百姓内心形成规则意识,法律(包括恶法)才能得到普遍的遵循。不然,有法不依,法不责众,法治就成了皇帝的新衣。这好好干资本主义的规则意识,便是韦伯所谓资产者/发财奴的伦理,美其名曰“新教伦理”。不过,他是反果为因,说颠倒了,以为人是为了获拯救,才干下地狱的勾当即发财的。耶稣怎么说的?富人进天国,比骆驼穿针眼还难(《马可福音》10:25)。

智能社会不同,它是数码规则引领潮流,算法制定,硬性的。硬规则的制定和实施,大多是商家行为,无须走政治程序酝酿论辩、表达民意,也不靠公众/用户的内心约束或法治意识。你看我这手机,没有下载打车软件,我就被排除在了打车出行的硬规则之外。如需打车,就要请年轻人帮忙,获准进一趟硬规则世界。

中国社会,虽然宣布了法治“初步建成”,似乎还是硬规则占优势。相对本本上的法条或软规则,国人显然更认可“物理规则”。比如单位入口的路障、马路中央的隔栏,没有这些物理屏障即硬规则,光是立一块牌子,贴一纸告示,怕是不起作用的。这个现象,应了一句流行的口号,“法无禁止皆可为”。意谓凡法律(软规则)缺乏执行力的地方,什么事都做得,从高铁霸座、P2P骗局到“世界首例基因编辑婴儿”。常有人怪罪国人的民族性格。但回想起来,硬规则兴盛,软规则衰落,肇始于新时期,八十年代,是跟整个社会的职业伦理、政治伦理的消解同步的。因为之前,总体来说,人比较规矩。不像现在,家家户户门窗安得比动物园的铁笼子还严实。

文汇报:像支付宝的推广,我们这里势如破竹,但在国外,包括发达经济体,互联网金融并没有这样容易被接受。

冯象:没错。习惯了硬规则,对于智能时代层出不穷的“便捷服务”,就不会太反感;自媒体网络舆论,也容易接受资本关于“万众创新”的宣传。智能产品的推广,不要求培育公众的法治意识。因为在我们依托AI建设的“美好新世界”——硬规则世界,日常生活中的每一次交易,都是数码信息的交换,用户都100%执行了硬规则指令:提交个人信息。

如此高效的执法,是“法治社会”没法抗拒的。原先受制于执法成本,很多事情“睁一只眼闭一只眼”。倘若严格执法(软规则当硬规则用),如欧盟今年实施的《通用数据保护条例》全面加强个人隐私保护,则不免拖累了智能产业。现时欧盟的AI研发跟市场占有,已经明显落后于美、中了。

智能社会,又名零隐私世界。扎克伯格看得很准,用户不在乎隐私,愿意拿它换取便利和舒适。反正衣食住行都离不开AI了,让它24小时追踪我们,收集一点个人隐私生理信息,又算什么?你想,按照旧的法治标准,隐私是多重要的权利,在许多国家属于宪法保护。可是这么快,大家就抛开旧法治,一键出让了隐私。如今好些大学的学生宿舍,进门都是人脸识别。还有不久前曝光的华大科技与华山医院,未经许可同牛津大学开展遗传资源的合作研究,违规收集孕妇基因信息,受到科技部行政处罚。基因信息也是个人隐私,但此类科研涉及重大公共利益,政府必须管一管。

文汇报:真是可怕。您说的这种老百姓在不知情或者无所谓的情况下拱手交出个人信息,会不会催生一种新的法治形态呢?

冯象:对呀,硬规则也是一种法治。只不过立法由公权力向资本开放,很大程度上跳过了民主程序,包括公共辩论、利益集团游说,变得“单纯”而高效了。它只用产品劝说,用广告取悦,用绝佳的用户体验,抚摸人心底最隐秘的欲望;而你只要开始用这产品,做一回用户,就是硬规则的胜利。

如此,在眼花缭乱的新产品新服务新应用背后,“赤裸裸”地,解除伦理约束,露出了资本的獠牙。资本不是政府,更不是人民政府,它不承担人民福祉、社会保障的责任。硬规则的实施,也无须缝一片“新教伦理”的遮羞布。相反,依照资本逐利的本性,硬规则败坏着一切伦理,并从伦理败坏的社会汲取养分而滋长,蔓延,覆盖我们的生活。这智能化的法治因而变得难以掩饰社会矛盾,渐渐失去了法治的“教化”或生产法盲之用。而新法治的建设,原本放在第一位的,便是这意识形态功能。

文汇报:如果是这样,政府和企业比较合理的关系是什么?公权力应该全面出手吗?

冯象:这个问题我在书里也讲到了。我的看法,随着社会深度智能化,传统上我们归于私法(民商法)的问题,都会变成公法问题,亦即变为“国家同企业、公众和政府以及政府各部门之间的法律关系”(页195)。这倒不是因为一些经济学家成天担心的“国进民退”,而是AI硬规则技术所致。什么意思呢?既然AI如此成功,核心平台垄断了越来越多的交易,而私企开发的网络金融工具又天天攻城略地,金融风险大增,那么平台的运作就不能脱离政府监管了,一如其创立不能没有政府支持。“央行为何要建网联平台,清算第三方网络支付?为了防止电商巨鳄独占金融大数据,造成国家可能受AI资本要挟的危险”(页208)。

冯象:这个问题我在书里也讲到了。我的看法,随着社会深度智能化,传统上我们归于私法(民商法)的问题,都会变成公法问题,亦即变为“国家同企业、公众和政府以及政府各部门之间的法律关系”(页195)。这倒不是因为一些经济学家成天担心的“国进民退”,而是AI硬规则技术所致。什么意思呢?既然AI如此成功,核心平台垄断了越来越多的交易,而私企开发的网络金融工具又天天攻城略地,金融风险大增,那么平台的运作就不能脱离政府监管了,一如其创立不能没有政府支持。“央行为何要建网联平台,清算第三方网络支付?为了防止电商巨鳄独占金融大数据,造成国家可能受AI资本要挟的危险”(页208)。

换一角度,也可以说,AI经济如同AI尖端技术,也是国家与社会安全问题。国安战线,不可能交给任何私企负责。故只要平台的垄断再上一个台阶,踩到国家的底线——物联网底层数据汇总一处,算法成为法律(即硬规则),私法就开始消亡了。

所以说,“AI发展到高级阶段,人类迫于形势,为了生存繁衍,其实仅有一个选项:公有化”(页209)。

文汇报:谈到公有制,圣西门曾有这样的论断,大意是未来社会主义社会可能通过治理,而非阶级斗争的方式实现。您在书中也指出,人工智能或将是我们走向共产主义的捷径:“共产主义能否提前实现,不待阶级斗争结束,国家消亡?”

冯象:惟愿如此。因为另一条路,资本主义私有制走到黑,恐怕阶级斗争只会益发激烈。当贫富鸿沟固化,财富高度集中,一切产品、服务连同物联网底层数据,彻底知识产权化,那会是什么景象?“超人”统治,法西斯暴政。

阿西莫夫的“机器人三定律”,根本的一条,是机器不得伤害人类。但是按照资本主义的逻辑,机器如果比人聪明,学会了资本及其附庸的自私自利,它干吗老老实实伺候人类,而不“以其人之道还治其人之身”?所以我在书里说,待到那一天,AI的飞速进步,将迫使人类在改造世界的同时也改造自己,第二次起来,废除普遍的剥削与压迫,做共产主义新人。

什么样的人,配得上新的人机伦理,可称新人呢?无非是“毫无自私自利之心”,品德“高尚”“纯粹”,所做的一切都“脱离了低级趣味”并且“有益于人民”。这样的人联合而成一个新社会,才能确保“人与人、人与机器、机器与机器之间,要由共同的世界观价值观维系。否则,就走不出资本主义,消除不了战争和奴役”(页212)。

共产主义,自古便是人类家庭生活和亲密友谊的一般理想;一如合作劳动、共享收成,是人的“本性”,或物种繁衍优势(见拙文《给未来的人们留个纪念》,载《好奇心日报》2017.10.18)。

文汇报:您一定关注到,最近麻省理工获得捐赠,筹建计算与人工智能学院。捐赠者苏世民先生说,选择麻省理工,是因为它“专业知识和价值观都适于担任AI的‘真北’(true north)”,而新“学院对道德的关注至关重要,因为……AI改变社会结构的力量越来越大。如果不加控制,这些技术最终可能伤害人类。”

冯象:我太太是校友,收到了校长关于建院的信。校长也非常强调,前沿科技须有价值观的指导同伦理约束。他说,人工智能有几个难题,一是懂的人太少。即使在麻省理工,90%的人也所知甚少,更别说公众和政客了。第二,AI技术的社会风险极大,亟需推动人机伦理研究,探讨规制的理论与方法。第三,至少迄今为止,AI加剧了贫富分化,使得大量资源集中到一小撮人手里。

我们可以补充一点:AI技术因为广泛用于日常生活,并迅速军事化,受市场机制的激励,很容易价格“白菜化”。一旦做成廉价商品,就更难有效管制了,不论订立多少部法规、国际条约。这方面不乏前车之鉴,但在资本主义市场经济的条件下,前景不容乐观。

文汇报:人工智能的发展令我们生活发生这么深刻的变革,会不会推翻“理性人假设”等西方经济学、法学的基础理论呢?

冯象:“理性人”或“经济理性人”(恩格斯管他叫“英国人”)假设,是资本主义正当化叙事的文宣重点,有年头了。在中国亦不例外。我总觉得,这假设跟十九世纪市场资本主义处于“初级阶段”、司法技术和侦察/监控手段不甚发达有关。假说扮作公理,即可把许多疑难问题、无法或不便处理的纠纷等等,挡在政法制度的门外;从而使司法程序复杂化,增加诉讼成本,遮掩实质规范所保护的资本利益和特权。

理性只是人这个物种的众多能力之一。以生物学心理学观之,人若是想修炼成一个“经济理性人”,太难了。否则发财当资本家,何须“新教伦理”呢?还是文学家艺术家敏感,他们很善于描绘人的不那么理性的一面。尤其进入资本主义时代,几乎所有伟大的文艺作品,都是对“理性人”的批判、嘲讽或厌弃。

所谓零隐私的人,也即硬规则之子;他心底的欲望和阴影、一闪而过的念头,全在“天眼”关照之下。理性人假设对于司法,犹如对于市场营销网络诈骗,基本是多余的了。也许经济学、法学用作文宣,“理论滞后”有别的考量?

文汇报:西方世界有奴隶制的传统,是否也反映在他们对机器人的态度上呢?我的意思是,雅典民主是建立在保有奴隶的基础上的,因为大量使用奴隶劳动,自由民才有时间精力参与城邦政治。资本主义兴起后,承担这一角色的是殖民地人民和黑奴;到了全球化时代,则是第三世界的打工仔。今天发展AI,原本指望机器人当个好仆人,实际上却有可能主奴关系发生反转,于是恐惧起来。

冯象:学界讨论人机伦理,例如阿西莫夫三定律,往往隐含一个前提:主奴关系。可是总有一天,机器的才智会远超人类,主奴关系就维持不了了。

其实,只要机器获得独立的自我意识,即便毫无当人类主子的意愿,人机关系(对于人类)也会变得异常复杂而失控。

常有论者不信AI会发展出自我意识。然而在AI学界,明斯基他们早已确认了这一可能。而机器一旦演进到能够区分人我、自我保护、自我复制(即繁衍)的水平,就不能把它看成是一个没有自我意识而被设定为人类仆役的物品,或一件聪明的工具。相反,机器将学会做道德价值判断,会追求并维护自身利益,还会有自尊心,有自己的朋友圈,乃至爱欲嫉恨等各样感情。那时,它将如何看待我们?注意,AI的自我意识演进是不可逆的;我们无法逆转历史,“穿越”亦非明智的选项。

所以明斯基说,他很幸运,这辈子不用面对这一困难选择。但也有学者认为,他的“感知器”(Perceptrons)理论“误导”了学界,是机器学习和神经网络研究在七十年代陷于停顿的罪魁祸首。或许我们需要一位新的明斯基,就是以他的权威和洞见,劝喻人类放慢脚步,不妨再过一个漫长的“AI冬天”;以便我们能有充裕的时间做好准备,全面规划,与AI携手(见利求同《隐私的未来》,载《文化纵横》6/2018)。这样留有余地,也许风险会小些。

文汇报:最后,冯先生,如果让您开一门新课,“人工智能与人类未来”,您会挂出一份怎样的课前阅读/视觉材料呢?

文汇报:最后,冯先生,如果让您开一门新课,“人工智能与人类未来”,您会挂出一份怎样的课前阅读/视觉材料呢?

冯象:这些内容,我们课上每年都讨论的。不过我只讲七八本书,玛丽·雪莱的《弗兰肯斯坦》,歌德《浮士德》,马列经典同中国革命文献,包括回忆录和年谱。并由此上溯西方宗教的乌托邦传统,如耶稣运动的穷人福音纲领、公有制社团组织原则、平等主义理想,等等。

论文选题及相关材料,我总是让学生自己找,因为多数是研究生选修,也有三五个优秀的本科生。他们往往想法很好,但不知如何着手。因此特别需要鼓励,去接触社会现实。无论电竞、手游的流行文化/异端生成机制,还是下工厂农村调研,和农民工姐妹一起站到流水线上,经受硬规则的盘剥,都是那“已经来到”的“未来”的一个征兆。目的是给他们一个锻炼机会,摆脱充斥着我们大学教育的教条主义,反思旧法治衰亡之际,主奴关系的根源。

这一代年轻人大学生,焦虑迷惘的不少。我希望,探索人机伦理能够帮助同学们找到人生的方向,从而当机器换人全面铺开之日,能够把阅读与思考化为行动的勇气。

(本报记者 李纯一,见习记者 陈瑜)

二〇一八年十一月于五角场

原载《文汇学人》2018.12.7

冯象:《我是阿尔法:论法和人工智能》,牛津大学,2018;中国政法大学,2018。